Энтропия непрерывного источника информации

(дифференциальная энтропия) [1, 2 и др.]. В предыдущих параграфах была рассмотрена мера неопределенности выбора для дискретного источника информации. На практике мы в основном встречаемся с источниками информации, множество возможных состояний которых составляет континуум. Такие источники называют непрерывными источниками информации. Во многих случаях они преобразуются в дискретные посредством использования устройств дискретизации и квантования. Вместе с тем существует немало и таких систем, в которых информация передается и преобразуется непосредственно в форме непрерывных сигналов. Примерами могут служить системы телефонной связи и телевидения. Оценка неопределенности выбора для непрерывного источника информации имеет определенную специфику. Во-первых, значения, реализуемые источником, математические отображаются непрерывной случайной величиной. Во-вторых, вероятности значений этой случайной величины не могут использоваться для оценки неопределенности, поскольку в данном случае вероятность любого конкретного значения равна нулю. Естественно, однако, связывать неопределенность выбора значения непрерывной случайной величины с плотностью распределения вероятностей этих значений, относящихся к любому сколь угодно малому интервалу непрерывной случайной величины, вероятность конечна, попытаемся найти формулу для энтропии непрерывного источника информации, используя операции квантования и последовательного перехода при уменьшении кванта до нуля

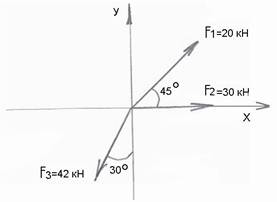

Рис. 3.3 С этой целью разобьем диапазон изменения непрерывной величины X характеризующейся плотностью распределения вероятностей W(x), на конечное число n малых интервалов шириной Δ x (рис. 3.3). При реализации любого значения x, принадлежащего интервалу (xi, xi+Δ x), будем считать, что реализовалось значение xi дискретной случайной величины X. Поскольку Δ x мало, вероятность p(xi≤ x≤ xi+Δ x) реализации значения x из интервала (xi, xi+Δ x):

Тогда в соответствии с (3.5) информация на один отсчет такого квантованного сигнала равна (отсчеты полагаем некоррелированными):

так как

Переходя к пределу при Δ x→ 0, получаем, что энтропия на один отсчет непрерывного источника сообщений равна

Первый член правой части (3.19)

называется дифференциальной энтропией непрерывного распределения (источника непрерывного сообщения). Величина h(x) имеет конечное значение. Она не зависти от шага квантования Δ x, а зависит только от закона распределения непрерывной величины x. Второй член правой части (3.19), напротив, не зависит от характеристик источника сообщений, а определяется только шагом квантования Δ x уровня сигнала. Можно легко проследить влияние его на энтропию сигнала: при увеличении или уменьшении величины Δ x энтропия соответственно монотонно убывает или возрастает. Свойства дифференциальной энтропии. 1. Дифференциальная энтропия в отличии от энтропии дискретного источника является относительной мерой неопределенности. Ее значение зависит от масштаба случайной величины X, а следовательно, и от выбора ее измерения. Изменим масштаб случайной величины X, например, в k раз, оставив неизменным масштаб равномерно распределенной в единичном интервале случайной величины X, принятой за эталон. Если xk = kx, то W(xk)=W(x)/k. Тогда

Если одновременно изменить масштаб величины X, то относительная неопределенность также изменится, так как значение эталона будет уже иным. Из относительности дифференциальной энтропии следует, что энтропия может принимать положительные, отрицательные и нулевые значения. 2. Дифференциальная энтропия не зависит от конкретных значений случайной величины X и, в частности, от изменения всех ее значений на постоянное. Действительно, масштаб X при этом не меняется и справедливо равенство

3. Какие же непрерывные распределения обладают максимальной дифференциальной энтропией? а) Если единственным ограничением для случайной величины X является область ее возможных значений [α, β ], то максимальной дифференциальной энтропией обладает равномерное распределение вероятностей в этой области. При доказательстве решается задача определения плотности распределения W(x), обеспечивающей максимальное значение функционала

при ограничении

Используя, например, метод неопределенных множителей Лагранжа. получим

Нетрудно убедится в том, что найденная функция W(x) обеспечивает максимум функционала h(X), причем

б) Если ограничения на область значений непрерывной случайной величины X отсутствуют, но известно, что дисперсия ее ограничена, то максимальной дифференциальной энтропией обладает нормальное распределение величины X. При доказательстве решается задача определения функции W(x), обеспечивающей максимальное значение функционала

при ограничениях

где σ – среднеквадратическое отклонение от математического ожидания (σ – заданное ограничение). Искомую плотность распределения W(x) находят, например, методом неопределенных множителей Лагранжа. Она оказывается гауссовской:

Вычислив функционал (3.25) для этого распределения, получим значение максимальной дифференциальной энтропии hmax(X). В двоичных единицах неопределенности

Поскольку в информационных системах сигнала, описываемый случайной величиной X, часто представляет собой электрическое напряжение (или ток), дисперсия X пропорциональна средней мощности сигнала. Тогда в соответствии с (3.26) можно утверждать, что при заданной мощности наибольшей средней неопределенностью выбора будет обладать источник, генерирующий сигналы, амплитуды которых распределены по нормальному закону. 4. Соотношения для дифференциальной энтропии объединения статистически зависимых непрерывных источников аналогичны соответствующим формулам для дискретных источников:

где

Пример 3.4 Определить, насколько мы выиграем в мощности, используя для организации мешающего воздействия, характеризующегося энтропией, источник шума с гауссовской плотностью распределения по сравнению с источником, имеющим в интервале [α, β ] равномерную плотность распределения. В соответствии с (3.27) дифференциальная энтропия гауссовского распределения

где σ г2 – дисперсия, характеризующая мощность, выделяемую на резисторе с сопротивлением в 1Ом. Для равномерного распределения энтропия определена соотношением (3.24):

Вычислим дисперсию σ р2 равномерного на интервале [α, β ] распределения:

Из условия обеспечения равенства энтропий следует

Возведя (3.31) в квадрат и подставив в (3.29) получим

Следовательно, искомый выигрыш составляет 42%.

3.5 Передача информации от дискретного источника [1 и др.]. Передача информации инициируется либо самим источником информации, либо осуществляется по запросу. Количество информации, полученное адресатом, определяется мерой снятой неопределенности (см. раздел 3.1, формула (3.6))

где H1 – энтропия источника, H2 – энтропия в приемнике, оставшаяся после получения сигнала. Основное понятие теории информации – количество информации – рассматривается в данном параграфе применительно к передаче отдельных статистически несвязанных элементов сообщения. Дискретный источник сообщений при этом полностью характеризуется ансамблем

Выясним, насколько будет изменяться неопределенность относительно состояния источника сообщения при получении адресатом элемента сообщения с выхода канала связи. Алфавиты передаваемых и принимаемых элементов сообщения считаем идентичными. Вследствие воздействия помех полученный элемент сообщения в общем случае отличается от переданного. Подчеркнем это различие. Обозначим принимаемые элементы сообщения другими буквами: s1, …, sj, …, sN. Априорная неопределенность (неопределенность до получения элемента сообщения) относительно состояния источника не является полной. Предполагается, что адресату известен алфавит элементов сообщения, а из прошлого опыта он знает вероятности их появления. Считая, что состояния источника реализуются независимо, априорная частная неопределенность появления элемента сообщения zi.

где p(zi) – априорная вероятность появления элемента сообщения zi. Предполагаются также известными некоторые сведения относительно помех в канале связи. Обычно считают, что между элементами сообщения и помехой статистические связи отсутствуют, искажения отдельных элементов сообщения являются событиями независимыми и адресату известна совокупность условных вероятностей p(zi|sj) (1≤ i≤ N, 1≤ j≤ N) того, что вместо элемента сообщения zi будет принят элемент сообщения sj. При получении конкретного элемента сообщения sj адресату становится известным значение условной вероятности p(zi|sj), называемой апостериорной (послеопытной) вероятностью реализации источником элемента сообщения zi. Это позволяет найти апостериорную частную неопределенность, остающуюся у адресата относительно выдачи источником элемента сообщения zi после получения конкретного элемента сообщения sj:

Поскольку получение информации мы связываем с уменьшением неопределенности, естественно определить частное количество информации I(zi), получаемое при приеме элемента сообщения sj относительно некоторого реализованного источником элемента сообщения zi как разность частных неопределенностей, имевшихся у адресата до и после получения элемента сообщения (априорной и апостериорной):

Анализ формулы (3.33) позволяет сделать следующие заключения: 1) частное количество информации растет с уменьшением априорной и увеличением апостериорной вероятностей реализации элемента сообщения источником, что находится в полном соответствии с нашими интуитивными представлениями; 2) частное количество информации об элементе сообщения zi может быть не только положительным, но и отрицательным, а также нулем, что зависит от соотношения априорной p(zi) и апостериорной p(zi|sj) вероятностей. Если вероятность того, что источником был реализован элемент сообщения zi увеличилась после приема элемента сообщения sj, т.е. p(zi|sj) > p(zi), то полученное частное количество информации положительно. Если эта вероятность не изменилась, т.е. p(zi|sj) = p(zi), то имевшая место неопределенность тоже не изменилась и частное количество информации равно нулю. Наконец, случай p(zi|sj) < p(zi) соответствует увеличению неопределенности относительно реализации zi после получения элемента сообщения sj, и, следовательно, частное количество информации отрицательно; 3) в случае отсутствия помех апостериорная вероятность p(zi|sj)=1. При этом частное количество информации численно совпадает с частной априорной неопределенностью реализации данного элемента сообщения zi;

Это максимальное частное количество информации, которое можно получить об элементе сообщения zi; 4) частное количество информации относительно реализации источником элемента сообщения zi, содержащееся в принятом элементе сообщения sj, равно частному количеству информации относительно sj, содержащемуся в элементе сообщения zi:

Хотя имеют место случаи, где важно оценить частное количество информации I(zi, sj), для задачи анализа и оптимизации функционирования информационных систем более рациональны усредненные характеристики, отражающие статистические свойства источника информации и канала связи. Найдем среднее количество информации, содержащееся в любом принятом элементе сообщения относительно переданного (реализованного) источником. До получения конкретного элемента сообщения средняя неопределенность, имеющаяся у адресата, относительно реализации источником любого элемента сообщения равна энтропии источника. Ее называют априорной энтропией источника. Средняя неопределенность относительно любого состояния источника, остающаяся у адресата после получения конкретного элемента сообщения sj, характеризуется частной условной энтропией H(Z|sj):

Это случайная величина, зависящая от того, какой конкретно элемент сообщения принят. Средняя неопределенность по всему ансамблю принимаемых элементов сообщений равна условной энтропии источника H(Z|S):

или

Эту условную энтропию называют апостериорной энтропией источника информации. Таким образом, при наличии помех среднее количество информации, содержащееся в каждом принятом элементе сообщения, относительно любого переданного равно разности априорной и апостериорной энтропией источника:

Представив априорную и апостериорную энтропии соответственно выражениям (3.5) и (3.36) и проведя несложные преобразования, получим формулу для количества информации непосредственно через вероятности:

|

(3.19)

(3.19) (3.20)

(3.20) (3.21)

(3.21) (3.22)

(3.22)

(3.23)

(3.23) (3.24)

(3.24) (3.25)

(3.25) и

и

(3.26)

(3.26) (3.27)

(3.27) (3.28)

(3.28)

(3.29)

(3.29) (3.30)

(3.30) (3.31)

(3.31)

(3.32)

(3.32) (3.33)

(3.33)

(3.34)

(3.34) (3.35)

(3.35)

(3.36)

(3.36) (3.37)

(3.37) (3.38)

(3.38)