Теоремы кодирования для канала связи

Пусть

бит информации на каждый кодовый символ. Параметр R получил наименование скорость передачи или скорость кода. Именно соотношение между этим параметром и пропускной способностью кода C определяет потенциальную достоверность передачи данных по каналу. Данный факт является сущностью двух замечательных теорем Шеннона. Теорема 3.5.1. (Обратная теорема канального кодирования). При скорости передачи R, большей информационной емкости канала связи C, никакой код не обеспечит произвольно малой вероятности ошибки декодирования, т.е. абсолютно надежной передачи сообщений. Обратную теорему кодирования можно доказать в самой общей форме, не опираясь на какую-либо конкретную модель канала. Для этого можно воспользоваться неравенством Фано, связывающим остаточную энтропию и вероятность ошибки декодирования. Доказательство. Пусть для передачи используется код со скоростью В предположении, что между сообщениями и кодовыми словами существует взаимно однозначное соответствие, на основании следствия 3.2.2 С другой стороны из (3.15) следует

Отсюда и из (3.19) имеем

График функции Доказанный результат весьма многозначителен, свидетельствуя, что надежная связь при скоростях выше информационной емкости в принципе невозможна. Однако еще более важным окажется устанавливаемый ниже факт, что при скоростях, меньших информационной емкости, в принципе достижима сколь угодно высокая надежность передачи. Теорема 3.5.2. (Прямая теорема кодирования для ДКБП.) Для дискретного канала без памяти при скоростях R, меньших информационной емкости C, всегда существует код, обеспечивающий сколь угодно малую вероятность ошибочного декодирования. Попытки доказательства прямой теоремы кодирования для произвольного дискретного канала оказываются несостоятельными. Дело в том, что предложить для общей модели канала некоторый рецепт кодирования сообщений, который при определенных условиях

где множитель

Верхняя граница средней вероятности ошибки  (иногда называемой экспонентой случайного кодирования) является экспоненциально строгой, означая, что для лучших кодов достаточно большой длины (иногда называемой экспонентой случайного кодирования) является экспоненциально строгой, означая, что для лучших кодов достаточно большой длины  она дает очень точное приближение истинной вероятности ошибки декодирования. Следовательно, она может служить верным ориентиром, насколько хорош или плох некоторый конкретный код. Широко распространена практика сравнения вероятности ошибки декодирования подобных кодов с данной границей, чтобы оценить по достоинству характеристики кодов. Графики на рис. 3.4 демонстрируют типичную зависимость она дает очень точное приближение истинной вероятности ошибки декодирования. Следовательно, она может служить верным ориентиром, насколько хорош или плох некоторый конкретный код. Широко распространена практика сравнения вероятности ошибки декодирования подобных кодов с данной границей, чтобы оценить по достоинству характеристики кодов. Графики на рис. 3.4 демонстрируют типичную зависимость  от от  в соответствии с соотношением (3.22), а также типичную форму функции надежности в соответствии с соотношением (3.22), а также типичную форму функции надежности  в зависимости от скорости в зависимости от скорости  . .

Прямая теорема кодирования Шеннона представляет собой типичную математическую теорему существования. Она не дает рецепта построения даже одного подобного хорошего кода. Именно теория кодирования посвящена отысканию путей практической утилизации потенциального качества передачи, провозглашаемой прямой теоремой кодирования. Отметим, что с учетом доказанного для любых каналов обратного утверждения (теорема 3.5.1) установленный результат говорит о том, что значение информационной емкости C является порогом, превышение которого скоростью R исключает возможность передачи с произвольно высокой надежностью, тогда как условие

|

– ансамбль

– ансамбль  равновероятных сообщений источника,

равновероятных сообщений источника,  – ансамбль соответствующих им кодовых слов длины n, поступающих на вход канала связи с выхода кодера,

– ансамбль соответствующих им кодовых слов длины n, поступающих на вход канала связи с выхода кодера,  – множество векторов наблюдения на выходе канала, а

– множество векторов наблюдения на выходе канала, а  – ансамбль решений, которые являются результатом преобразования векторов наблюдений. Данные условия означают, что предпринята попытка передавать по каналу

– ансамбль решений, которые являются результатом преобразования векторов наблюдений. Данные условия означают, что предпринята попытка передавать по каналу (3.20)

(3.20) , где

, где  . Покажем, что при этом полная вероятность ошибочного декодирования

. Покажем, что при этом полная вероятность ошибочного декодирования  больше некоторой положительной константы d.

больше некоторой положительной константы d.

. Учитывая, что ансамбль решений V есть отображение

. Учитывая, что ансамбль решений V есть отображение  . Поэтому

. Поэтому  .

. , т.е.

, т.е.  . Из (3.7) вытекает

. Из (3.7) вытекает  , а при равной вероятности сообщений

, а при равной вероятности сообщений  , поэтому с учетом (3.20) получаем

, поэтому с учетом (3.20) получаем .

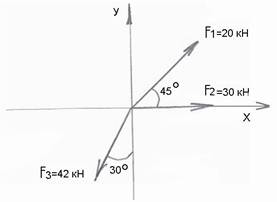

. Рис. 3.3.

Рис. 3.3.

, или

, или . (3.21)

. (3.21) представлен на рис. 3.3, из которого видно, что при всех

представлен на рис. 3.3, из которого видно, что при всех  вероятность ошибки декодирования

вероятность ошибки декодирования  в

в  . Так как при

. Так как при

, то

, то  , что и доказывает теорему.

, что и доказывает теорему. обеспечивал бы снижение до нуля вероятности ошибки с ростом длины кодового слова

обеспечивал бы снижение до нуля вероятности ошибки с ростом длины кодового слова  , (3.22)

, (3.22) канала. Величина

канала. Величина

принципиально гарантирует такую возможность. Напомним в связи с этим уже появлявшееся ранее параллельное наименование для информационной емкости – пропускная способность.

принципиально гарантирует такую возможность. Напомним в связи с этим уже появлявшееся ранее параллельное наименование для информационной емкости – пропускная способность.