Закон распределения непрерывной случайной величины. Плотность распределения вероятности.

Для непрерывных случайных величин невозможно применить закон распределения в формах, приведенных выше, т.к. непрерывная величина имеет бесчисленное («несчетное») множество возможных значений, сплошь заполняющих некоторый интервал. Поэтому составить таблицу, в которой были бы перечислены все ее возможные значения, или построить многоугольник распределения нельзя. Кроме того, вероятность какого-либо ее конкретного значения очень мала (близка к 0). Вместе с тем, различные области (интервалы) возможных значений непрерывной случайной величины обычно не являются одинаково вероятными. Таким образом, и здесь есть некий закон распределения, хотя и не в прежнем смысле. Рассмотрим непрерывную случайную величину Х, возможные значения которой сплошь заполняют некоторый интервал (а, b)*. Закон распределения вероятностей такой величины должен позволить найти вероятность попадания ее значения в любой заданный интервал (х1, х2), лежащий внутри (а,b*) (рис.3.2.)

Эту вероятность обозначают Р(х1 <Х< х2), или Р(х1 £ Х £ х2). Рассмотрим сначала очень малый интервал значений от х до (х + Dх) (см. рис.3.2.) Малая вероятность dР того, что случайная величина Х примет какое-то значение из этого малого интервала (х, х + Dх), будет пропорциональной величине этого интервала Dх: dР ~ Dх, или, вводя коэффициент пропорциональности f, который сам может зависеть от х, получаем: dР = f(х) × Dх. (3.2) Введенная нами здесь функция f(х) называется плотностью распределения вероятностей случайной величины Х или, короче, плотностью вероятности (плотностью распределения). Уравнение (3.2) можно рассматривать как дифференциальное уравнение и тогда вероятность попадания вели.чины Х в интервал (х1, х2) равна: Р (х1< Х < х2) = Графически эта вероятность Р (х1< Х < х2) равна площади криволинейной трапеции, ограниченной осью абсцисс, кривой f(х) и прямыми Х = х1 и Х = х2 (см. Рис.3.3), что следует из геометрического смысла определенного интеграла (3.3). Кривая f(х) при этом называется кривой распределения.

Из (3.3) видно, что если известна функция f(х), то изменяя пределы интегрирования, можно найти вероятность для любых интересующих интервалов. Поэтому именно задание функции f(х) полностью определяет закон распределения для непрерывных случайных величин Х. Для плотности распределения вероятности f(х) должно выполняться условие нормировки в виде:

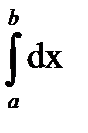

если известно, что все значения Х лежат в интервале (а, b), или в виде:

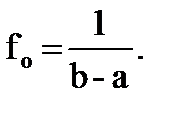

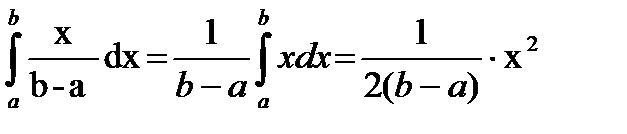

Результаты, изложенные в параграфах 3.1 и 3.2, показывают, что полную характеристикуо дискретной или непрерывной случайных величинах дают законы их распределения.Однако во многих практически значимых ситуациях пользуются так называемыми числовыми характеристиками случайных величин, главное назначение которых – выразить в сжатой форме наиболее существенные особенности их распределения. Важно, что эти параметры представляют собой конкретные (постоянные) значения, которые можно оценивать с помощью полученных в опытах данных. Этими оценками занимается так называемая «Описательная статистика».В теории вероятностей и математической статистике используется достаточно много различных характеристик, здесь мы рассматриваем наиболее часто употребляемые. Лишь для части из них приведены формулы, по которым рассчитываются их значения, в остальных случаях вычисления оставим компьютеру. 3.3.1.Характеристики положения: математическое ожидание, мода, медиана. Именно онихарактеризуют положение случайной величины на числовой оси, т.е. указывают некоторые важные ее значения, которые характеризуют распределение остальных значений. Среди них важнейшую роль играет математическое ожидание М(Х). а). Математическое ожидание М(Х) случайной величины Х является вероятностным аналогом ее среднего арифметического Для дискретной случайной величины оно вычисляется по формуле: М(Х) = х1р1 + х2р2 + … + хnрn = Пример. Вычислите среднее значение непрерывной случайной величины, имеющей на отрезке (a, b) равномерное распределение. Решение: При равномерном распределении плотность вероятности на интервале (a, b) постоянна, т.е. f(х) = fo = const, а вне (a, b) равна нулю, и из условия нормировки (4.3) найдем значение f0: Поэтому M(X) = Таким образом, математическое ожидание М(Х) совпадает с серединой интервала (a, b), определяющей б). Модой Мо(Х) дискретной случайной величины называют ее наиболее вероятное значение (рис.3.4, а), а непрерывной – значение Х, при котором плотность вероятности максимальна (рис.3.4,б). в). Еще одна характеристика положения – медиана (Ме) распределения случайной величины.

. .

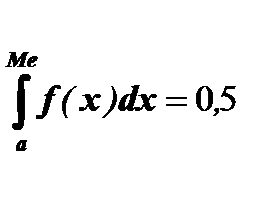

Поэтому медиану можно вычислить из уравнения:

Графически медиана – это значение случайной величины, ордината которой делит площадь, ограниченную кривой распределения, пополам (S1 = S2) (рис.3.4,в). Этой характеристикой обычно пользуются только для непрерывных случайных величин, хотя формально ее можно определить и для дискретных Х. Если М(Х), Мо(Х) и Ме(Х) совпадают, то распределение случайной величины называют симметричным, в противном случае – асимметричным. Характеристики рассеяния – дисперсия и стандартное отклонение (среднее квадратичное отклонение). Дисперсия D (X) случайной величиныХ определяется как математическое ожидание квадрата отклонения случайной Х от ее математического ожидания М(Х): D (X) = M [X – M(X)]2, (3.9) или D (X) = M (X2) – [M(X)]2 . (3.9а) Поэтому для дискретной случайной величины диперсия вычисляется по формулам: D(X) = а для непрерывной величины, распределенной в интервале (a,b): D (X) = a для интервала (-∞,∞): D (X) = Дисперсия характеризует среднее рассеяние, разбросанность значений случайной величины Х относительно ее математического ожидания. Само слово «дисперсия» означает «рассеяние». Но дисперсия D(Х) имеет размерность квадрата случайной величины, что весьма неудобно при оценке разброса в физических, биологических, медицинских и др. приложениях. Поэтому обычно пользуются другим параметром, размерность которого совпадает с размерностью Х. Это среднее квадратичное отклонение случайной величины Х, которое обозначают s (Х): s (Х) = 3.4Нормальный закон распределения случайных величин Нормальный закон распределения (закон Гаусса) играет исключительно важную роль в теории вероятностей. Во-первых, это наиболее часто встречающийся на практике закон распределения непрерывных случайных величин. Во-вторых, он является предельным законом, в том смысле, что к нему при определенных условиях приближаются другие законы распределения. Нормальный закон распределения характеризуется следующей формулой для плотности вероятности:

, (3.13) , (3.13)

Здесь х - текущие значения случайной величины X, а М(X) и s - ее математическое ожидание и стандартное отклонение, которые полностью определяют функцию f(x). Таким образом, если случайная величина распределена по нормальному закону, то достаточно знать только два числовых параметра: М(Х) и s, чтобы полностью знать закон ее распределения (3.13). График функции (3.13) называется нормальной кривой распределения (кривой Гаусса). Он имеет симметричный вид относительно ординаты х = М(Х). Максимальная плотность вероятности, равная С возрастанием s максимальная ордината кривой убывает, а сама кривая становится более пологой, растягиваясь вдоль оси абсцисс, тогда как при уменьшении s кривая вытягивается вверх, одновременно сжимаясь с боков (рис. 6). Естественно, что при любых значениях М(Х) и s площадь, ограниченная нормальной кривой и осью Х, остается равной 1 (условие нормировки):

Нормальное распределение симметрично, поэтому М(Х) = Мо(Х) = Ме(Х). Вероятность попадания значений случайной величины Х в интервал (x1,x2), т.е. Р (x1 < Х< x2) равна Р (x1 < Х < x2) =

Р (М(Х) - s < Х < М(Х) + s) = 0,6827 = 68,27%. (3.16) Р (М(Х) - 2s < Х < М(Х) + 2s) = 0,9545 = 95,45 %. (3.17) Р (М(Х) - 3s < Х < М(Х) + 3s) = 0,9973 = 99,73 %. (3.18) Из (3.18) следует, что значения нормально распределенной случайной величины Х с параметрами М(Х) и s с вероятностью Р = 99,73% лежат в интервале М(Х) ± 3s, иначе в этот интервал попадают практически все возможные значения данной случайной величины. Такой способ оценки диапазона возможных значений случайной величины известен как «правило трех сигм». Пример. Известно, что для человека рН крови является нормально распределенной величиной со средним значением (математическим ожиданием) 7,4 и стандартным отклонением 0,2. Определите диапазон возможных значений этого параметра. Решение: Для ответа на этот вопрос воспользуемся “правилом трех сигм”. С вероятностью равной 99,73% можно утверждать, что диапазон значений рН для человека составляет 7,4 ± 3·0,2, т.е 6,8÷8. Математическое ожидание (Expected Value, EV) является основным понятием в теории вероятностей, которое служит для усредненной оценки некоторого случайного значения. Математическое ожидание похоже на центр тяжести, если считать вероятности значений массами точек. Допустим, в результате игры возможны n различных вариантов исходов, вероятность каждого случая равна pi. Тогда математическое ожидание величины x, которая принимает значения xi для каждого случая вычисляется по формуле: E(x) = x1p1 + x2p2 +... + xnpn, В случае, когда вероятности исходов одинаковы (p1=p2=...=pn=1/n) формула принимает вид среднего арифметического: E(x) = x1/n+ x2/n +... + xn/n = (x1 + x2 +... + xn) / n Почему понятие математического ожидания является самым важным в теории вероятностей? Оказывается, с его помощью можно прогнозировать оценку значения некоторого случайного признака при достаточно долгом периоде испытаний. Используя приведенную выше аналогию с центром тяжести, можно сказать, что любое физическое тело, находясь в неопределенном состоянии, будет стремиться принять состояние равновесия (опоры на свой центр тяжести), точно также и среднее значение любой случайной величины при достачно большом количестве испытаний будет стремиться к своему матожиданию. Этот факт строго доказывается в курсе теории вероятностей. Числовые характеристики случайных величин (СВ). Основные свойства математического ожидания и дисперсии СВ. Полной, исчерпывающей характеристикой СВ является закон распределения. Универсальным законом распределения является функция распределения: F(x)=p{X<x} В приложениях удобно использовать числовые характеристики, которые дают суммарное представление о СВ. Математическое ожидание Мат. ожидание является характеристикой центра распределения (группирования значений) СВ. Мат. Ожидание дискретной СВ Х, заданной законом распределения называется величина численно равная сумме произведений значений СВ на соответствующие значения вероятностей: M(x) называется средним значением СВ. М(х) равняется среднему арифметическому значению всех наблюдений при неограниченном увеличении числа наблюдений. Если х – непрерывная СВ, заданная плотностью распределения f(x), то мат. ожидание: В качестве меры центральных тенденций могут быть использованы другие величины. Модой СВ Х (М0 Х) называется её наиболее вероятное значение (для дискретной СВ), для непрерывной – это точка максимума плотности распределения. Медианой СВ Х (Ме Х) называют такое значение, что р{x<Me(x)}=p{x>Me(x)}=. В случае симметричных распределений характеристики М(х), Ме(х), М0(х) совпадают. Дисперсия Рассмотрим величину х-М(х) – это отклонение СВ от её математического ожидания (М(х)). Построим ряд распределения: х-М(х) x1-M(1) x2-M(2) … xn-M(n) р р1 р2 … рn M(x-M(x))= = Следовательно М(х) является единственной точкой, относительно которой сумма всех отклонений равна 0. ОПР. Дисперсией СВ Х называется математическое ожидание квадрата её отклонения от М(х): D(x)=M(x-M(x))2. В случае дискретной СВ: D(x)= Для непрерывной СВ: D(x)= Для вычисления дисперсии удобно пользоваться формулой: D(x)=M(x2)-M(x)2 Доказательство: D(x)= =M(x2)-M(x)2. Среднеквадратичное отклонение: σ(х)= Простейшие свойства мат. ожидания и дисперсии: 1. Если С-константа, то М(С)=С, D(C)=0; 2. M(x+C)=M(x)+C, D(x+C)=D(x) Доказательство: M(x+C)= 3. M(Cx)=C*M(x), Доказательство: Для дискретной СВ: М(Сх)=. Для непрерывной СВ: М(Сх)=. D(Cx)=M(Cx-M(Cx))2=M(Cx-CM(x))2=M(C2(x-M(x)2))=C2M(x-M(x))2=C2D(x) 4. M(x+y)=M(x)+M(y) Если x и y независимые СВ, то D(x+y)=D(x)+D(y).

|

f(х) dх. (3.3)

f(х) dх. (3.3)

f(х) dх = 1, (3.4)

f(х) dх = 1, (3.4) f(х) dх = 1, (3.5) если границы интервала для значений Х точно неизвестны. Условия нормировкиплотности вероятности (3.4) или (3.5) являются следствием того, что значения случайной величины Х достоверно лежат в пределах (а, b) или (-¥, +¥). Из (3.4) и (3.5) следует, что площадь фигуры, ограниченной кривой распределения и осью абсцисс, всегда равна 1.

f(х) dх = 1, (3.5) если границы интервала для значений Х точно неизвестны. Условия нормировкиплотности вероятности (3.4) или (3.5) являются следствием того, что значения случайной величины Х достоверно лежат в пределах (а, b) или (-¥, +¥). Из (3.4) и (3.5) следует, что площадь фигуры, ограниченной кривой распределения и осью абсцисс, всегда равна 1. .

. =

=  или М(Х) =

или М(Х) =  (3.7) где f(x) – плотность вероятности, dP= f(x)dx – элемент вероятности (аналог pi) для малого интервала Dx (dx).

(3.7) где f(x) – плотность вероятности, dP= f(x)dx – элемент вероятности (аналог pi) для малого интервала Dx (dx). = f0

= f0  = f0 × x |

= f0 × x |  = (b-a)f0, откуда

= (b-a)f0, откуда

|

|  =

=  (a + b).

(a + b). , т.е.

, т.е.  .

. (3.8)

(3.8) [хi – М(Х)]2 рi, или D(X) =

[хi – М(Х)]2 рi, или D(X) =  [x – M(X)] 2 f(x)dx, или D (X) =

[x – M(X)] 2 f(x)dx, или D (X) =  х2 f(x)dx – [M(X)]2. (3.11)

х2 f(x)dx – [M(X)]2. (3.11) [x – M(X)] 2 f(x)dx, или D (X) =

[x – M(X)] 2 f(x)dx, или D (X) =  х2 f(x)dx – [M(X)] 2. (3.12)

х2 f(x)dx – [M(X)] 2. (3.12) (3.13) Итак, математическое ожидание, мода, медиана, дисперсия и среднее квадратичное отклонение являются наиболее употребляемыми числовыми характеристиками распределений случайных величин, каждая из которых, как было показано, выражает какое-нибудь характерное свойство этого распределения.

(3.13) Итак, математическое ожидание, мода, медиана, дисперсия и среднее квадратичное отклонение являются наиболее употребляемыми числовыми характеристиками распределений случайных величин, каждая из которых, как было показано, выражает какое-нибудь характерное свойство этого распределения.

»

»  , соответствует математическому ожиданию `Х=М(Х), и по мере удаления от нее плотность вероятности f(х) симметрично спадает, постепенно приближась к нулю (рис. 3.5). Изменение значения М(Х) в (3.13) не меняет форму нормальной кривой, а приводит лишь к ее сдвигу вдоль оси абсцисс. Величина М(Х) называется также центром рассеяния, а среднеквадратичное отклонение s характеризует ширину кривой распределения (см. Рис.3.6).

, соответствует математическому ожиданию `Х=М(Х), и по мере удаления от нее плотность вероятности f(х) симметрично спадает, постепенно приближась к нулю (рис. 3.5). Изменение значения М(Х) в (3.13) не меняет форму нормальной кривой, а приводит лишь к ее сдвигу вдоль оси абсцисс. Величина М(Х) называется также центром рассеяния, а среднеквадратичное отклонение s характеризует ширину кривой распределения (см. Рис.3.6). f(х) dх = 1, или

f(х) dх = 1, или  . (3.15)

. (3.15)